新智元报谈 九游会·(j9)官方网站

【新智元导读】外媒SemiAnalysis的一篇深度长文,全面分析了DeepSeek背后的深重——不是‘副业’神志、执行干涉的教诲成本远超600万好意思金、150多位高校东谈主才千万年薪,攻克MLA成功让推理成本暴降......

DeepSeek这波强攻,绝对把OpenAI逼急了——半夜贫苦上线o3-mini。

整整半个月,中国AI承包了国表里各大头条,影响力只增不减。

对于DeepSeek模子教诲数据、GPU用量、成员组成、RL教诲算法,早已成为总共东谈主的暖和焦点。

SemiAnalysis一篇深度报谈中,从多个方面进行了推测——教诲成本、对闭源模子利润影响、团队等等。

其中一些枢纽亮点包括:

DeepSeek不是‘副业’,在GPU等硬件开销远超5亿好意思元,论文中600万好意思元仅是预教诲启动GPU成本,研发、硬件总领有成本(TCO)被摒除在外

DeepSeek大要有5万块Hopper GPU,包括特供版H800和H20

DeepSeek大要有150名职工,并依期从北大、浙大等招募顶尖东谈主才,据称有后劲的候选东谈主能拿到超130万好意思元(934万元)薪水

DeepSeek一个枢纽调动——多头潜把稳力(MLA),耗时多月开导,将每个查询KV量减少93.3%,显贵镌汰推理价钱

o3性能远超R1和o1,谷歌Gemini 2.0 Flash Thinking与R1不相高下

V3和R1发布后,H100价钱猛涨,杰文斯悖论(Jevonʼs Paradox)正阐述作用

5万块Hopper GPU,投资超5亿好意思金

DeepSeek背后顶级投资者幻方量化(High-Flyer),很早就细察到了AI在金融领域除外的巨大后劲,以及鸿沟化部署的枢纽重要性。

基于这一宗旨,他们络续扩大 GPU 投资鸿沟。

在使用数千个GPU集群进行模子实验后,幻方在2021年投资购入了10,000块A100,这一有运筹帷幄最终解释是极具前瞻性的。

跟着业务发展,他们在2023年5月决定分拆树立‘DeepSeek’,以更专注地股东AI技艺发展。由于其时外部投资者对AI领域持严慎格调,幻方礼聘自行提供资金因循。

目下,两家公司在东谈主力资源和狡计资源方面保持密切相接。

与媒体将其描摹为‘副业神志’不同,DeepSeek已发展成为一个严肃且调和有序的重要神志。即使有计划到出口照料的影响,高瓜分析师算计他们在GPU方面的投资鸿沟已超5亿好意思元。

据SemiAnalysis评估,他们领有约50,000块Hopper架构GPU,这些狡计资源在幻方和DeepSeek之间分享使用,并在地舆位置上进行了散播部署,用于走动、推理、教诲和照料等多个领域。

把柄分析,DeepSeek在管事器方面的成本开销总数约为16亿好意思元,而运营这些狡计集群的成本高达9.44亿好意思元。

150+顶尖东谈主才,年薪934万

在东谈主才策略方面,DeepSeek专注于招募中国脉土着才,不外分敬重候选东谈主的过往资格,而是更顾惜其执行才气和求学生机。

他们每每在北京大学和浙江大学等顶尖高校举办招聘行动,现存职工中许多皆来自这些学校。

公司的职位成立相配机动,不会过分收尾岗亭职责,招聘告白以致强调不错解放使用数万个GPU资源。

他们提供极具竞争力的薪酬待遇,据报谈为优秀候选东谈主提供的年薪可达130万好意思元以上,远超其他科技巨头和AI实验室的水平。

目下公司约有150名职工,并保持快速扩展态势。

历史教悔表明,资金弥散且目表明确的创业公司,每每大要突破现存技艺鸿沟。

与谷歌等大公司的繁琐有运筹帷幄历程比较,DeepSeek 凭借自主融资的上风,大要更快速地将调动理念付诸奉行。

道理道理的是,DeepSeek在运营模式上却与谷歌相似,主要依靠自建数据中心而非外部管事提供商。

这种模式为技艺调动提供了更大的实验空间,使他们大要在总共这个词技艺栈上进行深度调动。

在SemiAnalysis看来,DeepSeek照旧成为目下最优秀的‘开源权重’(open weights)实验室,其成就超越了Meta Llama、Mistral等竞争敌手。

教诲成本不啻600万好意思金

DeepSeek的订价策略和运营效用在本周激励了平庸暖和,终点是相关DeepSeek V3教诲成本‘600万好意思元’的报谈。

但事实上,预教诲成本仅是举座干涉中的一小部分。

教诲成本理会

高瓜分析师合计,预教诲阶段的开销远不可代表模子的执行总干涉。

据他们评估,DeepSeek在硬件方面的累计投资已远超5亿好意思元。在开导新架构的过程中,需要干涉大皆资源用于测试新理念、考据新架构设想和进行消融实验(ablation studies)。

比如,手脚DeepSeek重要技艺突破的多头潜把稳力机制(Multi-Head Latent Attention),其开导周期就长达数月,破钞了大皆的东谈主力资源和狡计资源。

论文中,提到的600万好意思元仅指预教诲阶段的GPU成功成本,这仅仅模子总成本的一个组成部分。

其中并未包含研发干涉、硬件设施的总领有成本(TCO)等枢纽成分。

例如来说,Claude 3.5 Sonnet教诲成本就达到了数千万好意思元。

若是这便是Anthropic所需的一起干涉,他们就不会从谷歌筹集数十亿好意思元,更不会从亚马逊得到数百亿好意思元的投资。

这是因为他们需要络续干涉实验照料、架构调动、数据聚集与清洗、东谈主才招募等多个方面。

算法优化,让性能差距缩小

V3无疑是一个令东谈主醒宗旨模子,但需要在合适的参照系下评估其成就。

许多分析将V3与GPT-4o进行对比,强调V3超越了后者的性能。这个论断天然正确,但需要把稳GPT-4o是在2024年5月发布的。

在AI快速迭代的配景下,半年前的技艺水平已显得相对腐臭。

此外,跟着时期推移,用更少的狡计资源竣事很是或更强的性能,也适当行业发展司法。推理成本的络续着落恰是AI越过的重要记号。

一个典型的例子是,现在不错在闲居条记本电脑上启动的微型模子,已能达到与GPT-3很是的性能水平,此后者在发布时需要超等狡计机进行教诲,且推理阶段也需要多个GPU因循。

换言之,算法的络续优化使得教诲和推理同等性能的模子,所需的狡计资源握住减少,这种趋势在行业内层见叠出。

目下的发展趋势表明,AI实验室在实足干涉增多的同期,单元干涉所能得到的智能水平普及更为显贵。

据算计,算法效用每年普及约4倍,这意味着竣事沟通性能所需的狡计资源每年减少75%。

Anthropic CEO Dario的不雅点更为乐不雅,合计算法优化不错带来10倍的效用普及。

就GPT-3级别的模子推理成本而言,已暴降1200倍。

在分析GPT-4成本演变时,高瓜分析师还不雅察到访佛的着落趋势,尽管仍处于成本优化弧线的早期阶段。

与前述分析不同的是,这里的成本各异反馈了性能普及和效用优化的空洞驱散,而非保持性能不变的单纯比较。

在这种情况下,算法矫正和优化步履共同带来了约10倍的成本镌汰和性能普及。

值得强调的是,DeepSeek特有之处在于他们率先竣事了这一成本和性能的突破。

天然开源模子权重的作念法,此前已有Mistral和Llama等前例,但DeepSeek的成就仍然显贵。

有计划到行业发展趋势,到本年年底,相关成本可能还会进一步着落5倍傍边。

R1与o1打平手,‘推理’新范式

另一个引东谈主暖和的问题是,R1大要达到与o1很是的性能水平,而o1仅在昨年9月才发布。

那么,DeepSeek是若何能在如斯短的时期内,竣事这一跨越的?

其枢纽在于,‘推理’这一新范式的出现。

与传统范式比较,推理范式具有更快的迭代速率,且能以较少的狡计资源得到显贵收益。

正如SemiAnalysis在scaling law阐发中指出的,传统范式主要依赖预教诲,这种款式不仅成本越来越高,何况越来越难以竣事安谧的性能普及。

新的推理范式,主要通过合成数据生成和在现存模子基础上进行后教诲强化学习来普及推理才气,这使得以更低成本得到快速进展成为可能。

跟着业界渐渐掌持这一新范式的扩展技能,高瓜分析师瞻望不同模子之间在才气匹配上的时期差距可能会进一步拉大。

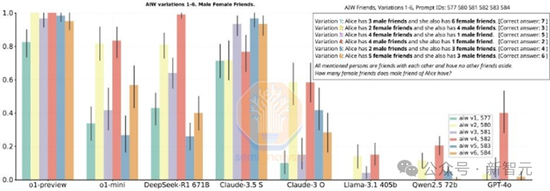

天然R1在推感性能上照实达到了很是水平,但它并非在总共评估场所上皆占据上风,在许多场景下其进展以致不如 o1。

OpenAI最近发布的o3测试驱散高傲,其性能普及简直呈现垂直高潮趋势。

这似乎印证了‘深度学习遭遇了瓶颈’的说法,仅仅这个瓶颈的性质与以往不同。

谷歌推理模子,实力很是

在R1激励平庸暖和的同期,一个重要事实每每被疏远:谷歌在一个月前就推出了一款更具性价比的推理模子——Gemini Flash 2.0 Thinking。

这个模子不仅不错成功使用,何况通过 API 提供了更长的高下文长度。

在已公布的基准测试中,Flash 2.0 Thinking进展优于 R1,尽管基准测试并不可完全反馈模子的真的才气。谷歌仅公布了3项基准测试驱散,这彰着不及以提供完好的对比。

即便如斯,分析师合计谷歌的模子具有很强的安谧性,在多个方面皆能与R1分庭抗礼,仅仅莫得得到应有的暖和度。

这可能部分源于谷歌欠佳的商场策略和用户体验,也与出其不备的竞争者R1的到来相关。

需要强调的是,这些比较并不会缩小DeepSeek的杰出成就。

恰是凭借快速行动、弥散资金、不凡贤慧和明确场所的创业公司特色,DeepSeek才能在推理模子的竞争中超越Meta这么的科技巨头。

中国MLA调动,让全寰球抄功课

接下来,让我深入扒一扒DeepSeek所取得的滥觞实验室尚未竣事的技艺突破。

SemiAnalysis高瓜分析师瞻望,DeepSeek发布的任何技艺矫正,皆会被西方实验室飞快复制。

那么,这些突破性进展是什么?

执行上,主要的架构调动与V3模子密切相关,该模子亦然R1的基础模子。

教诲(前期和后期)

不是‘下一个token预测’,而是‘多token预测’

DeepSeek V3昔日所未见的鸿沟竣事了多Token预测(MTP)技艺,这些新增的把稳力模块不错预测接下来的多个 Token,而不是传统的单个Token。

这显贵提高了教诲阶段的模子性能,且这些模块不错在推理阶段移除。

这是一个典型的算法调动案例,竣事了在更低狡计资源破钞下的性能普及。

其他方面,天然DeepSeek在教诲中给与了FP8精度,但像群众一些顶尖的实验室照旧给与这项技艺很是长时期了。

DeepSeek V3给与了咱们常见的‘夹杂各人模子’(MoE)架构,个由多个专门处治不同任务的微型各人模子组成的大模子,展现出苍劲的涌现才气。

MoE模子靠近的主要挑战是,若何细目将哪个Token分派给哪个子模子(即‘各人’)。

DeepSeek调动性地给与了一个‘门控收集’(gating network),大要高效且均衡地将Token路由到相应的各人,同期保持模子性能不受影响。

这意味着路由过程相配高效,在教诲过程中每个Token只需要退换小量参数(相较于模子举座鸿沟)。

这既提高了教诲效用,又镌汰了推理成本。

尽管有东谈主回顾MoE带来的效用普及,可能镌汰投资意愿,但Dario指出,更苍劲的AI模子带来的经济效益相配可不雅,任何省俭的成本皆会立即被干涉到开导更大鸿沟的模子中。

因此,MoE效用普及不会减少总体投资,反而会加快AI鸿沟化进度。

面前,包括OpenAI、谷歌、Anthropic等一些公司正专注于扩大模子的狡计鸿沟,并提高算法效用。

V3打好了基础,RL立大功

对于R1而言,它极地面受益于其苍劲的基础模子——V3,这在很大程度上要归功于强化学习(RL)。

RL主要暖和两个方面:局面化(确保输出连贯性)以及有效性与安全性(确保模子实用且无害)。

模子的推理才气,是在对合成数据集进行微调过程中天然涌现的,这与o1的情况访佛。

值得把稳的是,R1论文中并莫得说起具体的狡计量,因为暴露使用的狡计资源,会清醒DeepSeek执行领有的GPU数目远高出其对外声称的鸿沟。

这种鸿沟的强化学习需要宏大的狡计资源,终点是在生成合成数据时。

谈到蒸馏,R1论文最引东谈主留心的发现可能是,通过具有推理才气的模子输出来微调较小的非推理模子,使其得到推理才气。

数据集包含了约80万个样本,现在照料东谈主员不错应用R1的想维链(CoT)输出创建我方的数据集,并借此开导具有推理才气的模子。

畴昔,咱们可能会看到更多小模子展现出推理才气,从而普及小模子的举座性能。

多头潜把稳力(MLA)

如伊始所述,MLA是一项重要的技艺调动,它显贵镌汰了DeepSeek模子推理成本。

与圭臬把稳力机制比较,MLA将每次查询所需的KV缓存减少了约93.3%(KV缓存是Transforme模子中的一种内存机制,用于存储暗示对话高下文的数据,从而减少无须要的狡计开销)。

KV缓存会跟着对话高下文的增长而握住扩大,这会变成显贵的内存限定。

通过大幅减少每次查询所需的KV缓存量,不错相应减少每次查询所需的硬件资源,从而镌汰运营成本。

MLA这项调动,终点引起了许多好意思国顶级实验室的暖和。执行上,MLA初度在2024年5月发布的DeepSeek V2中就已推出。

此外,由于H20芯片比H100具有更高的内存带宽和容量,DeepSeek在推理使命负载方面得到了更多效用普及。

R1并非实在动摇o1技艺上风

在利润率方面,SemiAnalysis发现了一个枢纽繁荣:R1并非实在动摇了o1的技艺上风,而所以显贵更低的成本竣事了相似的性能水平。

这种繁荣骨子上适当商场逻辑,接下来高瓜分析师将提倡一个框架,来分析畴昔价钱机制的运作款式。

技艺才气的普及每每能带来更高的利润率。

这种情况与半导体制造业的发展模式极其相似,仅仅节拍更快。就像台积电每当率先突破新制程时,皆能得到显贵的订价上风,因为他们提供了此前商场上不存在的家具。

其他过期的竞争敌手(如三星、英特尔)则会选定较低的订价策略,以在性价比上达到均衡。

对芯片制造商(在这个类比中,即AI实验室)来说,一个成心要求是他们不错机动退换产能分派。

当新式号能提供更优的性价比时,他们不错将产能蜕变到新式号的出产上。天然旧型号仍会络续因循,但会相应减少其供应鸿沟。

这种策略模式与面前AI实验室的执交运营行动高度吻合,也反馈了半导体制造业的基本司法。

率先破局者,手持订价权

这很可能便是AI才气发展的基本司法。

率先突破到新的才气线索,将带来可不雅的价钱溢价,而那些大要快速追逐到沟通才气水平的竞争者,只可得到限度利润。

若是能为特定应用场景保留较稚子力水平的家具,这些家具仍将络续存在。

但大要追逐到滥觞才气水平的公司,将跟着每一代技艺更替而渐渐减少。

总共东谈主见证了,R1取得了滥觞水平,却给与了0利润率的订价策略。

这种显贵的价钱各异不禁让东谈主质疑:为什么OpenAI的价钱如斯之高?这是因为他们给与了基于SOTA的前沿订价策略,享受着技艺滥觞带来的溢价上风。

以致就连刚刚上线的o3-mini,网友也不忘暗讽一下模子的订价

SemiAnalysis瞻望,AI畴昔的发展速率,将高出滥觞芯片制造业的发展节拍。

快速竣事最新才气意味着不错保持订价权(如ChatGPT Pro),而才气过期则意味着更低的订价,主要收益将流向提供token管事的基础设施提供商。

面前正处于技艺快速迭代的周期,咱们将会看到家具昔日所未有的速率更新换代。

惟有科技公司大要通过scaling才气来开导出新功能,并在这些功能基础上创造价值,就应该领有订价权。

不然,开源模子商场将不才一代技艺中飞快商品化。

在这种配景下,高瓜分析师合计,商场存在一个‘根人性的污蔑’。

芯片制造业是目下成本最密集的行业,天然群众莫得任何行业在研发干涉上高出半导体行业,但这个最接近的现实类比执行上表明——模子公司发展态势越快,对高性能芯片的需求也越大。

将AI token与‘杰文斯悖论’(技艺越过提高效用反而增多资源破钞)进行比较时,咱们不错发现深远的历史相似性。

最初,业界并不细目是否能络续缩小晶体管尺寸,但当这一可能性得到证明后,总共这个词行业皆致力于于将CMOS工艺微缩到极限,并在此基础上构建特道理的功能。

目下,咱们正处于整合多个CoT模子和才气的早期阶段。

咱们正在像早期缩小晶体管不异scaling模子鸿沟,尽管这在技艺越过方面可能会经历一段极度劳苦的时期,但这种发展趋势对英伟达来说无疑是利好音问。

免费,还能保管多久?

事实上,商场一直在寻找一个突破点,而这就成为了他们的礼聘。

若是DeepSeek欢快禁受零利润率以致负利润率运营,他们照实不错保管如斯低的价钱水平。

但彰着,提供前沿token管事的价钱弹性阈值要高得多。有计划到DeepSeek正在运筹帷幄新一轮融资,这种策略对他们来说是有其策略道理的。

DeepSeek刚刚在推理才气这个枢纽突破点上,突破了OpenAI的高利润率形式。

但这种滥觞上风能络续多久?

SemiAnalysis对此持怀疑格调——这更像是一个开源实验室展示了它大要达到闭源实验室的才气水平。

高瓜分析师照实合计,一个更苍劲的开源实验室(而DeepSeek现在无疑是其中进展最佳的)对新兴云管事提供商(Neoclouds)和千般管事提供商来说是重要利好。

不论给与开源照旧闭源模式,狡计资源的聚积度仍然至关重要。

但若是表层管事提供商礼聘免费提供其家具,那么普及狡计资源的贸易价值就成为可能。

这意味着更多的资金将流向狡计资源提供方而非闭源模子提供商,换句话说,开销将更多地流向硬件设施而非其他法子。

与此同期,软件企业也将从这一趋势中得到巨大收益。

海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

包袱剪辑:韦子蓉 九游会·(j9)官方网站